Im letzten Artikel über Zombie-Projekte gingen wir von einem Spiel mit vollständiger Information aus: Auftraggeber und Auftragnehmer wissen beide, dass das Projekt gescheitert ist, aber niemand will der Erste sein, der es zugibt. Das Nash-Gleichgewicht zwingt beide in ein pathologisches “Weiter so”.

In der Realität großer Organisationen ist das Setup jedoch oft noch toxischer. Wir verlassen das Feld der vollständigen Information und betreten die Welt der Informationsasymmetrie. Willkommen beim “Wassermelonen-Projekt”: Außen grün, innen rot.

Die tickende Uhr der Informationsasymmetrie

In diesem Szenario weiß die Basis (die Entwickler), dass das Projekt auf eine Katastrophe zusteuert. Architekturen skalieren nicht, Releases können nicht geliefert werden. Das Management meldet dem Kunden jedoch: “Status Grün”.

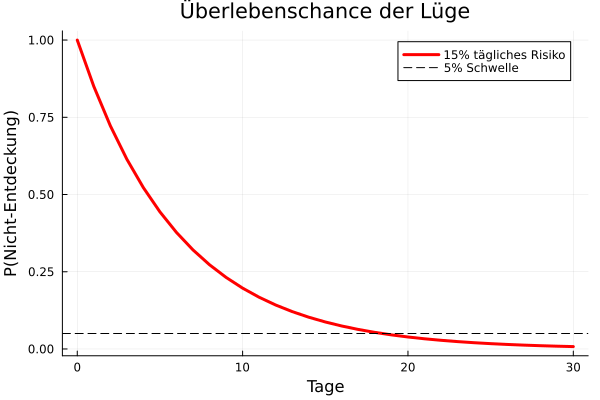

Spieltheoretisch ist das ein riskantes Unterfangen, denn das Aufrechterhalten dieser Lüge ist ein stochastischer Prozess. Jeden Tag gibt es eine gewisse Wahrscheinlichkeit $p_i$, dass das Desaster durch ein Audit, einen wütenden Entwickler oder einen Komplettausfall ans Licht kommt. Die Wahrscheinlichkeit, dass die Lüge bis zum Tag $n$ nicht auffliegt, schrumpft exponentiell:

$$P(\text{Nicht-Entdeckung}) = \prod_{i=1}^{n} (1 - p_i)$$Da $(1 - p_i) < 1$ ist, strebt das Produkt zwangsläufig gegen Null. Im Umkehrschluss bedeutet das: Das Risiko der Entdeckung geht mit zunehmender Zeit unaufhaltsam gegen 1.

Warum lügt das mittlere Management trotzdem weiter? Wegen der Gambler’s Fallacy – der irrationalen Hoffnung, dass das nächste Release wie durch ein Wunder die technischen Schulden von zwei Jahren auflöst. Und weil die Struktur des Projekts sie genau dazu zwingt.

Stack der Ahnungslosigkeit

Wie gelingt es einer Organisation überhaupt, eine derart massive rote Melone vor dem Kunden zu verstecken? Die Antwort liefert die Thermodynamik: Durch Informations-Entropie.

Jeder Knotenpunkt in einem Kommunikationsnetzwerk filtert Rauschen, aber in toxischen Projekten filtern die Knotenpunkte die Realität. Um das zu visualisieren, betrachten wir die Hierarchie eines natürlich rein hypothetischen IT-Projekts. Die Informationskette vom Code bis zum Geldgeber sieht dann so aus:

- Entwickler (Weiß: Der Code brennt, nichts baut mehr.)

- Scrum Master / Lead Engineer (Versucht, den Brand mit Sprints zu löschen.)

- Product Owner / Teamleiter (Priorisiert Features, die auf der brennenden Architektur nicht laufen.)

- Release Train Engineer (Plant Zugabfahrten für Züge ohne Räder.)

- Requirements Engineer (Schreibt Spezifikationen für eine Idealwelt.)

- Project Manager (PM) (Schiebt Jira-Tickets, ohne den Inhalt zu verstehen.)

- Projektleiter (PL) (Ignoriert Jira komplett, pflegt stattdessen Checkboxen in MS OneNote.)

- Interner Auftraggeber beim Dienstleister (Liest nur die OneNote-Zusammenfassung des PL.)

- Kunde (Sieht eine PowerPoint-Folie und zahlt die nächste Tranche.)

Der Rauschfilter-Effekt

Was wir hier sehen, ist keine Projektsteuerung, sondern eine Kaskade von Ghost-Agents. Die meisten Schichten in dieser Kette (besonders PM und PL) treffen keinerlei inhaltliche Entscheidungen. Sie haben nur eine einzige Funktion: Harte, technische Fakten (Costly Signals aus Jira oder der CI/CD-Pipeline) in weiche, gefällige Metadaten (Soft Signals in OneNote oder PowerPoint) zu übersetzen.

Jede Stufe glättet die Kanten der Wahrheit ein bisschen mehr. Der Entwickler schreit: “Die Datenbank-Locks töten das System!” – Der Product Owner macht daraus: “Wir haben technische Schulden im Backend.” – Der PL notiert in OneNote: “[x] Architektur-Review durchgeführt”. Beim Kunden kommt an: “Performance-Optimierungen on track”. Die Thermodynamik hat dafür sogar einen Namen — und die Physik zeigt, wie fundamental das Problem ist.

Information vernichten

In der Quantenmechanik gilt das Prinzip der Unitarität. Das bedeutet vereinfacht: Wenn du den exakten Zustand eines Systems in der Gegenwart kennst, musst du (theoretisch) die physikalischen Gesetze rückwärts laufen lassen können, um genau zu wissen, wie das System in der Vergangenheit aussah. Wenn du ein Buch verbrennst, ist die Information für uns zwar unlesbar (hohe Entropie), aber die Information der Buchstaben steckt quantenmechanisch immer noch in der genauen Flugbahn der Rauchpartikel und der Asche. Die Information ist gestreut, aber nicht vernichtet. 1974 bewies Stephen Hawking, dass Schwarze Löcher nicht komplett schwarz sind. Sie strahlen Energie ab (die Hawking-Strahlung) und schrumpfen dabei, bis sie irgendwann komplett “verdampfen”. Hawking zeigte, dass diese Strahlung rein thermisch (also völlig zufällig) ist. Sie enthält keinerlei Informationen darüber, was jemals in das Schwarze Loch gefallen ist. Die Information über das Buch wäre unwiederbringlich aus dem Universum gelöscht. Das bricht die Grundregel der Quantenmechanik. Die meisten Physiker (darunter am Ende auch Hawking selbst) gehen heute davon aus, dass die Information irgendwie entkommt. Es gibt faszinierende Erklärungsansätze:

- Das Holografische Prinzip: Die Information von allem, was in das Loch fällt, fällt gar nicht in die Singularität im Zentrum, sondern wird auf dem Ereignishorizont (der “Oberfläche” des Schwarzen Lochs) wie ein 2D-Hologramm gespeichert.

- Soft Hair (Weiche Haare): Eines der letzten Paper von Hawking argumentierte, dass Schwarze Löcher “Haare” aus Null-Energie-Photonen und Gravitonen auf ihrem Ereignishorizont haben, in denen die Quanteninformation wie in einer Festplatte codiert wird. Die verdampfende Strahlung nimmt diese Information dann beim Verlassen wie ein Fingerabdruck wieder mit.

Mathematisch zeigt sich das in der berühmten Bekenstein-Hawking-Entropie, die besagt, dass die Entropie (und damit der Informationsgehalt) eines Schwarzen Lochs proportional zu seiner Oberfläche ($A$) und nicht zu seinem Volumen ist: $$S_{BH} = \frac{k_B A}{4 \ell_P^2}$$ (Wobei $k_B$ die Boltzmann-Konstante und $\ell_P$ die Planck-Länge ist). Ein Projektleiter mit MS OneNote ist also eigentlich viel effizienter im Vernichten von Informationen als eine Singularität von mehreren Millionen Sonnenmassen.

Fazit: Das Ende der Steuerbarkeit

Wenn ein System so gebaut ist, dass unangenehme Wahrheiten auf dem Weg nach oben systematisch verschwinden, ist das kein Kommunikationsproblem — es ist ein Designproblem. Die Struktur erzeugt genau das Verhalten, das sie bestraft, wenn es zu spät ist.

Es handelt sich um organisierte Ahnungslosigkeit. Die Entscheidungen ganz oben basieren auf Informationen, die an Stufe 7 (dem PL) bereits restlos von der Realität entkoppelt wurden. Wenn der Aufprall kommt (weil das Entdeckungsrisiko die 1 erreicht hat), ist die Überraschung im Penthouse maximal – während im Maschinenraum alle nur müde mit den Schultern zucken.

Der einzige Ausweg ist radikale Informationshygiene: Entscheider müssen direkten Zugang zu Costly Signals haben — Deployment-Frequenz, Fehlerrate, offene Bugs — nicht zu deren OneNote-Zusammenfassung. Alles andere ist Kaffeesatzlesen mit Excel.

Kommentare